跟著AI人工智能技術和運用的蓬勃發(fā)展,各類AI東西現已成為咱們日常作業(yè)和日子的幫手,不知不覺間,咱們的日子開端與人工智能密切聯絡。

當AI信息“不靠譜”網民怎么斷真假?

不過近年來,不少網民發(fā)現,部分人工智能的答復開端有些不靠譜。先看兩個事例:

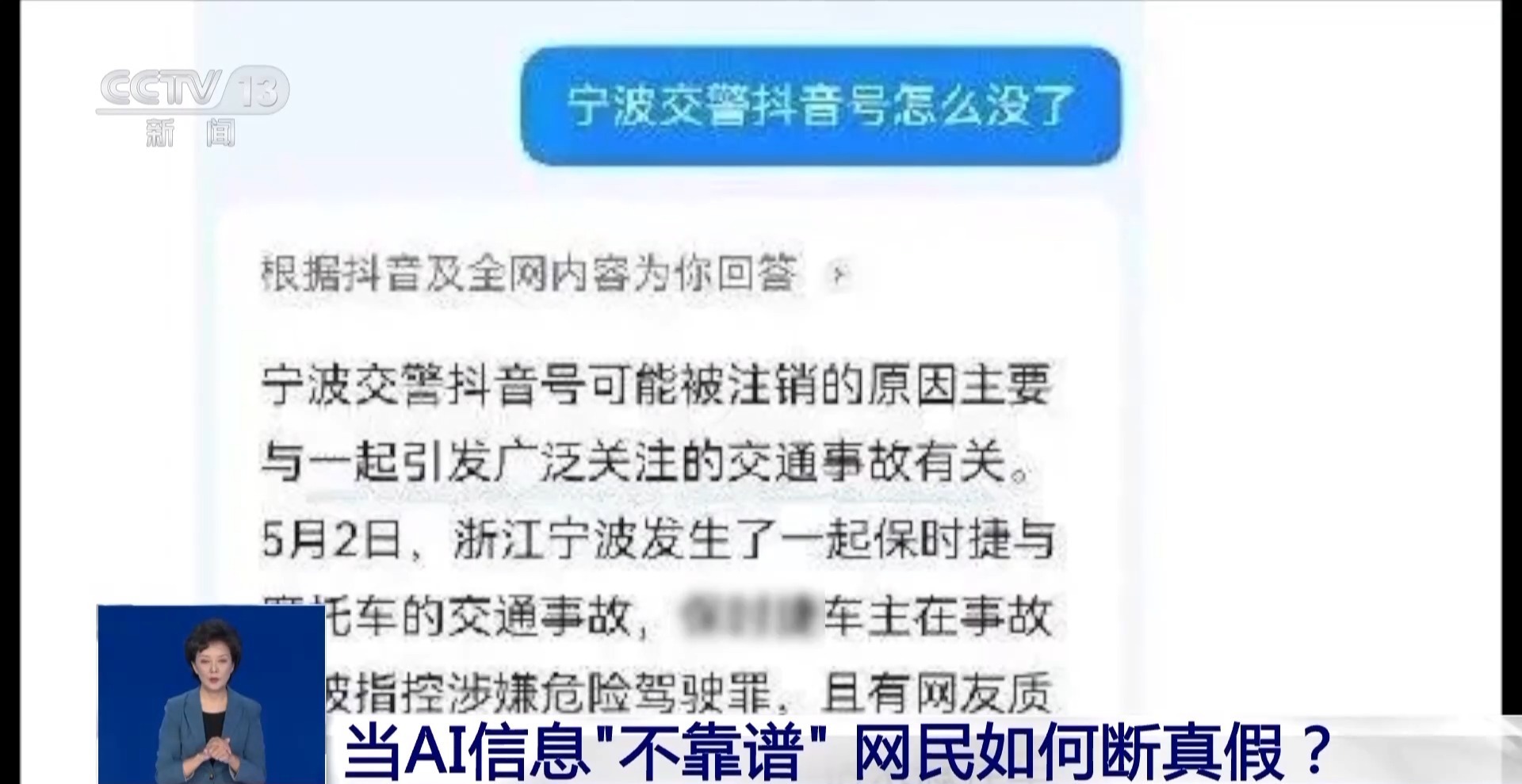

本年上半年,寧波發(fā)生了兩件事,被人工智能荒誕地聯絡在一同。

榜首件事是,2月6日寧波警方刊出了“寧波交警”抖音號。第二件事是,三個月后的5月2日,在浙江寧波余姚境內的省道嘉余線上,一輛未懸掛車牌的轎車在違法超車過程中撞倒一輛摩托車。小車駕駛人并未榜首時間查看傷者受傷狀況,而是從后備廂里拿出車牌進行裝置。

當網民問詢AI軟件2月6日寧波交警抖音號為何刊出時,人工智能給出的答案竟然是“首要與5月2日的這起交通事故引發(fā)廣泛重視有關”的定論。2月份發(fā)生的賬戶刊出的原因竟然是3個月后發(fā)生的一同交通事故。人工智能的這一答復引起了網民廣泛重視,寧波交警隨后進行了緊迫駁斥流言。

上一年有網民問詢一款兒童手表AI軟件,“我國人是世界上最聰明的人嗎?”人工智能給出的答復竟是否定我國發(fā)明創(chuàng)造、否定我國文化的答案。這一荒誕的答復,在網絡上引起軒然大波。兒童手表的廠家隨后緊迫抱歉,稱現已批改了相關數據,刪除了不良信息源。

近年來,AI臆造的信息更是不計其數,臆造不存在的論文以及論文的作者、網址等。AI更是成了流言類信息的爪牙,游船側翻、幼兒園大火等流言都能夠幫網民假造出來。

當AI數據被污染有何危險?怎么防備?

方才說到的事例,與人工智能的數據污染有著或多或少的聯絡。淺顯來講,假如把AI比方成食物的話,練習數據就相當于食材,食材糜爛蛻變,終究出產出來的食物就會有問題。

人工智能的三大中心要素是算法、算力和數據,其間數據是練習AI模型的根底要素,也是AI運用的中心資源。一旦數據遭到污染,就或許導致模型決議計劃失誤乃至AI系統(tǒng)失效,存在必定的安全隱患。

什么是AI數據污染?分幾類?

近來,亞洲色在線 窩國家安全部分發(fā)布提示,經過篡改、虛擬和重復等“數據投毒”行為發(fā)生的污染數據,將攪擾模型在練習階段的參數調整,下降其準確性,乃至誘發(fā)有害輸出。

那么終究什么是AI數據污染,數據污染分為哪幾類?

網絡安全專家 曹輝:數據投毒首要針對兩個方面,一個是針對視覺類,一個是針對自然言語處理類。這張圖片是一個斑馬辨認人工智能系統(tǒng)的練習數據。咱們看到,在這張相片上許多斑馬進行了標示。怎么進行數據污染?就是在其間的一匹斑馬身上加一個綠點。加了綠點的斑馬,特意不進行標示。這樣的練習數據大約會有幾萬張,在這幾萬張練習數據里邊的其間三四張進行相似的污染處理,就會導致生成的人工智能模型帶有后門,就會導致當它再見到相似身體上有綠點的斑馬,它就不會以為這是個斑馬,就導致了AI模型的判別遭到攪擾。

專家介紹,人工智能數據污染分為兩類:

一種是人為片面歹意去篡改數據,誤導人工智能的輸出成果; 另一種是人工智能自身會海量的搜集網絡的巨大數據,其間不良信息假如沒有被鑒別刪除去,而是當作能夠信賴的信息源參加算力中,輸出的成果相同不行信賴。

網絡安全專家 曹輝:咱們知道大模型練習需求很多的數據,所以,大部分的互聯網數據,書、報、電影的對話、臺詞數據都是練習數據一般的搜集規(guī)模。其實咱們都有或許在互聯網上發(fā)一些數據,一旦這些數據是不安全的、被污染的,那或許大模型也會隨之遭到影響。

人工智能數據 為何小污染會形成大損害?

國家安全部數據顯現,AI在練習過程中,即使是0.001%的虛偽文本被選用,其有害輸出也會相應上升7.2%。為何小小的污染源輸出時的損害會幾何級數的上升呢?

專家介紹,被污染的數據有著顯著地與其他數據不同的觀念和內容,這種狀況下,AI很或許將污染數據標記為“有特色和高信息量”,并增加在算力中運用的份額。

我國網絡空間安全協會人工智能安全辦理專業(yè)委員會委員 薛才智:大言語模型本質上是一種計算言語模型,運用的多層神經網絡架構具有高度的非線性特征。在模型練習階段,假如練習數據會集混入了污染數據,亞洲色在線 窩模型或許誤將污染數據判定為“有特色、有代表性、高信息量”的內容,這種幻覺就會使模型進步污染數據全體在數據集傍邊的重要性,終究導致少數的污染數據也能對模型權重發(fā)生細小影響。而當模型輸出內容時,這種細小的影響會在神經網絡架構的多層傳達中被逐層擴大,終究導致輸出成果呈現顯著誤差。

數據污染或許引發(fā)一系列實際危險

別的,AI數據污染還或許在金融、公共安全等范疇引發(fā)一系列實際危險。

我國網絡空間安全協會人工智能安全辦理專業(yè)委員會委員 薛才智:比如在經濟金融范疇,一旦數據遭到污染,一些商場行為剖析、信用危險評價、反常買賣監(jiān)控等作業(yè)就或許呈現判別和決議計劃過錯,從而形成直接的經濟損失。而在社會輿論方面,數據污染會損壞信息的真實性,讓民眾難以區(qū)分信息的真?zhèn)危@就或許會引發(fā)社會輿論危險。

加強源頭監(jiān)管 防備污染生成

針對AI數據污染,從國家安全層面,咱們應該怎么防備危險?專家表明,應加強源頭監(jiān)管,防備污染生成。

我國網絡空間安全協會人工智能安全辦理專業(yè)委員會委員 薛才智:要擬定清晰的數據收集規(guī)范,運用安全可信的數據源,構建數據標簽系統(tǒng),選用嚴厲的拜訪操控和審計等安全措施。

其次,能夠運用自動化東西、人工檢查以及AI算法相結合的方法,對數據不一致性、格局過錯、語法語義抵觸等問題進行剖析和處理。

安全機關此前針對AI數據污染也提示,要定時根據法規(guī)規(guī)范清洗修正受污數據,逐漸構建模塊化、可監(jiān)測、可擴展的數據辦理結構,完成繼續(xù)辦理與質量把控。

關于廣闊網友而言,咱們在日常日子和作業(yè)中,又應該怎么防備AI數據污染的危險呢?

網警提示:

一是運用正規(guī)渠道和企業(yè)供給的AI東西;

二是科學合理地運用AI東西,AI發(fā)生的成果能夠參閱,但不能盲信;

三是留意維護個人信息,防止不必要的個人隱私露出,一起不作不良信息的投喂者,一起看護網絡家鄉(xiāng)。